Un par de organizaciones globales de impulso al periodismo lanzaron respectivas iniciativas que vinculan el trabajo de los periodistas con el uso de la inteligencia artificial.

Una de ellas busca que periodistas vigilen a través de investigaciones el impacto de la inteligencia artificial en la vida de la gente, mientras que otra reúne a medios de varios países para trabajar en proyectos que potencien el trabajo de los periodistas mediante algoritmos y herramientas de automatización.

En ambas iniciativas hay una importante presencia de profesionales de los medios de América Latina que buscarán impulsar la presencia tanto de la región como de los idiomas español y portugués en la relación entre el periodismo y la inteligencia artificial en el mundo.

Como parte de su misión de impulsar la cobertura de historias de importancia global poco investigadas, el Pulitzer Center lanzó a principios de este año la AI Accountability Network (o red de rendición de cuentas sobre inteligencia artificial). La iniciativa pretende apoyar investigaciones periodísticas que aborden el uso de la inteligencia artificial por parte de gobiernos y corporaciones y crear una red mundial de periodistas que aprendan juntos y compartan conocimientos sobre el tema.

La organización presentó en junio a los 10 periodistas que conformarán la primera generación de becarios de su red, los cuales fueron elegidos de múltiples regiones del mundo. En representación de América Latina están la periodista Karen Naundorf y la fotoperiodista Sarah Pabst, originarias de Alemania pero que ejercen el periodismo en Argentina desde hace varios años.

La AI Accountability Network del Pulitzer Center pretende apoyar investigaciones periodísticas que aborden el uso de la inteligencia artificial por parte de gobiernos y corporaciones. (Foto: Pulitzer Center)

“Vimos que había muy pocos periodistas que estaban vigilando el tema de los algoritmos que toman decisiones que impactan la vida de la gente”, dijo a LatAm Journalism Review (LJR) Boyoung Lim, gerente de la red de inteligencia artificial del Pulitzer Center. “Pensamos que esto era algo en lo que podíamos intervenir y construir comunidad, capacidad y también, con suerte, colaboración entre periodistas para informar sobre los impactos de tecnologías como la inteligencia artificial y los algoritmos en las vidas de la gente y las comunidades en su conjunto”.

Naundorf es corresponsal en Sudamérica para la cadena suiza SRF y su trabajo ha sido publicado en medios como Revista Anfibia, The Washington Post y Der Spiegel. Por su parte, Pabst pertenece a Ayün Fotógrafas, un colectivo de ocho fotógrafas que aborda temas como identidad, derechos humanos, mujeres y medio ambiente de América Latina. Ambas publicaron el año pasado el especial “Femicidas de uniforme: los errores del sistema”, un reportaje de investigación sobre víctimas de feminicidio a manos de policías en Argentina, también con el apoyo del Pulitzer Center.

Naundorf y Pabst trabajarán juntas en la AI Accountability Network con una propuesta de proyecto periodístico escrito y visual sobre el uso de las tecnologías de automatización en Argentina y Brasil.

“Ellas combinarán sus especialidades para alcanzar a una audiencia más amplia mediante la visualización de algunas de las historias que producirán por medio de la fotografía de Sarah y otros efectos visuales innovadores”, dijo Lim. “Estoy muy emocionada por este proyecto por los elementos visuales, sobre cómo pueden los fotoperiodistas cubrir este tipo de historias sobre inteligencia artificial que parecen ser muy técnicas y abstractas”.

En la propuesta de proyecto con la que postularon a la AI Accountability Fellowship, Naundorf y Pabst plantearon preguntas críticas sobre la forma en la que los periodistas deberían cubrir las herramientas de inteligencia artificial que afectan la vida de las comunidades en todo el mundo y en especial en América Latina.

“Vivimos en un continente desigual y sabemos que existe el riesgo de que los sistemas de inteligencia artificial reproduzcan los sesgos humanos, lo que podría reforzar la desigualdad social”, dijo a LJR Naundorf. “La inteligencia artificial parece ser un tema que no preocupa al público o sobre el que no tiene influencia. [...] Aunque hay iniciativas ciudadanas, universitarias y de ONGs que cuestionan el uso de la inteligencia artificial, y que también buscan reparación judicial, éstas reciben relativamente poca cobertura mediática. Por esta razón, creemos que es un momento importante para mirar al continente, subrayando la necesidad de regulaciones y debate público”.

Los becarios recibirán hasta 20 mil dólares para llevar a cabo sus proyectos durante el resto de 2022. Además, contarán con mentorías y sesiones de formación para fortalecer sus reportajes.

Se espera que los reportajes sean publicados entre noviembre de este año y enero de 2023. Pero sobre todo, el Pulitzer Center busca que surjan proyectos colaborativos entre los integrantes de la primera generación del programa que continúen explorando la cobertura de la inteligencia artificial, aun después de terminada la iniciativa.

“Ya estamos viendo algunas potenciales colaboraciones entre los becarios, es muy emocionante. No puedo hablar mucho de los detalles, pero ya hay algunas coincidencias que vemos entre sus proyectos y ya están hablando de colaboraciones, así que va a ser muy interesante ver dentro de unos meses”, dijo Lim.

Pero, ¿por qué es importante que los periodistas vigilen el uso de la inteligencia artificial? El Pulitzer Center considera que la aplicación de estas tecnologías en materias como la seguridad pública, programas sociales, control de fronteras y recursos humanos, entre muchos otras, pueden alterar las dinámicas de poder al tratarse de tecnologías capaces de tomar decisiones en ocasiones en ventaja los sectores más privilegiados. De ahí la necesidad de ejercer la rendición de cuentas.

No se trata, dijo Lim, de perseguir a nadie o exigir explicaciones, sino de que los periodistas y eventualmente el público en general sean capaces de entender mejor esas tecnologías para tener las herramientas para cuestionar su uso en áreas cruciales para la sociedad.

“Se trata de mirar las tecnologías que están presentes en nuestra vida diaria con una lente de equidad y rendición de cuentas”, dijo. “Ojalá esta primera generación sea el comienzo de una creciente comunidad de periodistas de todo el mundo que coincida con nosotros en que todos deberíamos informar sobre inteligencia artificial y que debemos estar más pendientes de cómo estas tecnologías están transformando e influenciando nuestras vidas y a veces afectando desproporcionadamente a minorías y grupos marginados”.

Luego de dos años de llevar a cabo la iniciativa Collab Challenge, un experimento que reunió a periodistas de distintas partes del mundo para explorar soluciones innovadoras que mejoren el periodismo mediante la inteligencia artificial, la organización JournalismAI presentó en junio de 2022 a la primera generación de su JournalismAI Fellowship.

Se trata de una versión renovada de los Collab Challenges en la que 46 periodistas y técnicos de medios de 16 países trabajarán en diez equipos durante seis meses desarrollando proyectos que exploren cómo el uso responsable de la inteligencia artificial puede contribuir a construir un periodismo más sostenible, inclusivo e independiente en todo el mundo.

Un total de 46 periodistas y técnicos de medios de 16 países trabajarán en diez equipos durante seis meses como parte de la primera Journalism AI Fellowship. (Foto: JournalismAI)

A diferencia de los retos anteriores, la JournalismAI Fellowship tiene como particularidad que convocó no solo a periodistas sino también a profesionales técnicos de los medios de comunicación, quienes formarán equipo con parejas de otros medios para trabajar en un mismo proyecto.

Entre los 46 participantes seleccionados se encuentran representantes de cinco organizaciones de periodismo de América Latina. Schirlei Alves y Reinaldo Chaves, de Abraji (Brasil), harán equipo con Fernanda Aguirre y Gibrán Mena, de Data Crítica (México); Lucila Pinto y Nicolás Russo, de Grupo Octubre (Argentina), trabajarán en el mismo equipo de Sara Campos y Eduardo Ayala, de El Surti (Paraguay); y Juliana Fregoso y Matías Contreras, de Infobae (Argentina), harán pareja en otro equipo.

“Los diez equipos de becarios continúan la tradición de JournalismAI de fomentar la colaboración transfronteriza e interdisciplinaria, con científicos de datos, reporteros, gestores de productos, investigadores e ingenieros de software que trabajan juntos con compañeros de organizaciones de noticias en diferentes continentes, incluyendo colaboraciones entre medios legacy y medios digitales”, dijo la organización con sede en la London School of Economics and Political Science, en un comunicado.

Los proyectos de los equipos proponen la aplicación de la inteligencia artificial en funciones como el monitoreo de discurso de odio, la detección de contenido engañoso, el análisis automático de imágenes y el manejo de grandes cantidades de datos, entre otros. A través de sus proyectos, los participantes latinoamericanos buscarán impulsar el uso de estas tecnologías en los medios del Sur Global.

El equipo de El Surti y Grupo Octubre acordaron desarrollar una herramienta que identifique, clasifique y describa imágenes mediante el uso de visión computarizada. La intención es que la herramienta, que lleva el nombre inicial de Image2Text, reconozca objetos y personas en video, imágenes fijas e infografías y las describa tanto en inglés como en español.

Dada la naturaleza gráfica de El Surti, la herramienta ayudaría a que su contenido pueda ser consumido por un público más amplio, incluidas las personas con discapacidad visual, y tenga un mejor desempeño en los motores de búsqueda.

“Lo principal que hace que nuestro contenido no pueda rankear bien en las búsquedas [en Google] es porque son imágenes, ilustraciones, y son además ilustraciones que a veces son súper editoriales, entonces son difíciles de leer por robots”, dijo a LJR Sara Campos, integrante del equipo y editora de producto del medio paraguayo. “Empezamos a ver que también había una necesidad por parte de nuestros colegas de mejorar sobre todo un trabajo de SEO [optimización de motores de búsqueda, por sus siglas en inglés], de una distribución orgánica y natural [de su contenido]”.

El equipo de Image2Text es consciente de que seis meses es poco tiempo para desarrollar su herramienta al cien por ciento, sin embargo se han planteado el reto de entregar al final del programa al menos un prototipo que haya sido probado efectivo en al menos un caso de investigación.

“Estuvimos conversando hace poco y dijimos ‘no nos enfoquemos en la interfaz, enfoquémonos en que funcione por ahora para un caso específico’”, dijo Campos. “Quizá no va a haber una interfaz, sino que va a haber un repositorio de código, una biblioteca en un [archivo del portal de almacenamiento de códigos de aplicaciones] GitHub abierto. [...] Lo que estamos haciendo ahora es dirimir justamente en qué caso va a funcionar”.

Grupo Octubre y GMA News Online, el medio filipino que completa el equipo de Image2Text, llevaban propuestas similares de herramientas de reconocimiento de imágenes. Los tres medios coincidieron en que se habían topado con sesgos al momento de experimentar con estas herramientas de inteligencia artificial.

En el caso del medio argentino, una herramienta de reconocimiento de imágenes que desarrollaron previamente (como parte del Innovation Challenge 2021 de Google News Initiative), llamada Visión Latina, buscaba identificar en imágenes y videos a personajes relevantes en el mundo latino en idioma español.

Sin embargo, se encontraron con que la visión computarizada no es muy eficiente al intentar identificar a personajes del Sur Global, a diferencia de como lo hace con personajes del hemisferio norte.

“Eso es un sesgo gigantesco”, dijo Campos. “Entonces nuestra propuesta de trabajar una biblioteca de lenguajes [visuales] desde el sur para el sur es también como una postura política contra estos modelos. Vamos a ver si podemos lograrlo, porque es desafiante”.

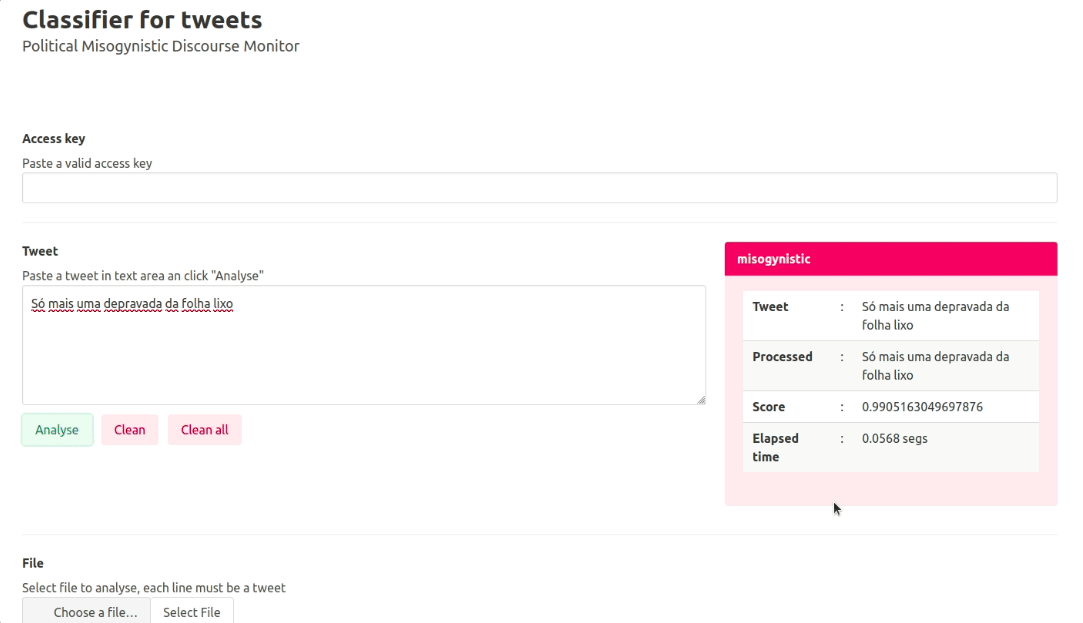

El Monitor de Discurso Político Misógino fue una herramienta desarrollada por periodistas de redacciones de América Latina en la iniciativa antecesora de la JournalismAI Fellowship. (Foto: Cortesía)

Los representantes de Infobae se toparon con un sesgo similar, en este caso relacionado con el hecho de que el inglés sigue siendo el idioma con el que funciona mejor la inteligencia artificial. El equipo en el que participa el medio con sede en Argentina, que incluye también a SkyNews (Reino Unido) y Il Sole 24 Ore (Italia), planea desarrollar una herramienta que funcione en inglés, español e italiano, cuyo objetivo será rastrear los temas, las marcas y los productos que comparten influencers en redes sociales, así como detectar contenido potencialmente dañino o engañoso.

“Efectivamente nos falta mucho para llegar a ese punto en el que la inteligencia artificial todavía pueda hablar perfectamente otros idiomas”, dijo a LJR Juliana Fregoso, project manager de inteligencia artificial de Infobae. “Creo que el idioma también es una barrera. Nosotros en América Latina hablamos español o portugués y son muy pocos los periodistas que realmente hablan inglés, entonces ese es un impedimento [para el uso de la inteligencia artificial en el periodismo]”.

Gracias a los perfiles de sus integrantes, este equipo pretende complementar su proyecto con metodologías de periodismo financiero y periodismo de datos. En cuanto al tipo de tecnología, pretenden usar herramientas de procesamiento de lenguaje natural (NLP, por sus siglas en inglés) y de construcción de bases de datos masivas, como Python, un lenguaje de programación de uso común por periodistas de datos.

Su idea es alimentar enormes bases de datos sobre las cuentas de redes sociales a analizar para que su herramienta extraiga lo que se publica en esas cuentas, lo procese y le otorgue un puntaje según qué tan engañoso o nocivo sea. Esta herramienta podrá ayudar a periodistas a investigar historias sobre publicidad engañosa en plataformas digitales.

“Nosotros tendremos que alimentar por ficheros, que muy probablemente armemos en Python, qué es lo que queremos extraer de esas cuentas y cómo nos van a dar las alertas para saber cuando se estén anunciando productos o se esté utilizando lenguaje que pueda ser potencialmente engañoso”, explicó Fregoso.

Por su parte, el equipo integrado por Abraji y Data Crítica tiene como proyecto el desarrollo de Attack Detector, un modelo lingüístico para detectar discurso de odio en redes sociales en español y portugués, dirigido principalmente hacia periodistas y activistas medioambientales.

Data Crítica participó previamente en el Collab Challenge 2021 de JournalismAI con el desarrollo del Monitor de Discurso Político Misógino, una herramienta que, mediante un modelo entrenado de procesamiento de lenguaje natural detecta discurso de odio contra mujeres en internet en español y portugués.

La JournalismAI Fellowship, que cuenta con el apoyo financiero de Google News Initiative y con la asesoría para los equipos por parte del Knight Lab de la Northwestern University, busca que estas iniciativas, lejos de reemplazar el trabajo de los periodistas, le agreguen valor y lo potencien mediante la automatización de tareas repetitivas y que normalmente tomarían mucho tiempo y esfuerzo a los seres humanos.

“Creo que podemos empezar a trabajar con una inteligencia artificial híbrida, en la que una parte efectivamente la haga la parte tecnológica y el resto que lo sigamos haciendo periodistas”, dijo Fregoso. “El uso de la inteligencia artificial dentro del periodismo yo no lo veo como una amenaza a que nos vaya a quitar el trabajo. Lo veo como una oportunidad para reinventar el periodismo”.