Algumas organizações globais que promovem o jornalismo lançaram iniciativas que vinculam o trabalho dos jornalistas ao uso de inteligência artificial.

Uma delas busca jornalistas para monitorar, por meio de investigações, o impacto da inteligência artificial na vida das pessoas, enquanto outra reúne veículos de diversos países para trabalhar em projetos que potencializam o trabalho dos jornalistas por meio de algoritmos e ferramentas de automação.

Em ambas as iniciativas há uma presença significativa de profissionais de mídia da América Latina que buscarão promover a presença tanto da região quanto das línguas espanhola e portuguesa na relação entre jornalismo e inteligência artificial no mundo.

Como parte de sua missão de aumentar a cobertura de histórias de importância global pouco pesquisadas, o Pulitzer Center lançou a AI Accountability Network no início deste ano. A iniciativa visa apoiar investigações jornalísticas que abordem o uso de inteligência artificial por governos e corporações e criar uma rede global de jornalistas que aprendam juntos e compartilhem conhecimento sobre o assunto.

Em junho, a organização apresentou os 10 jornalistas que comporão a primeira geração de bolsistas de sua rede, escolhidos em várias regiões do mundo. Representando a América Latina estão a jornalista Karen Naundorf e a fotojornalista Sarah Pabst, originárias da Alemanha, mas que exercem o jornalismo na Argentina há vários anos.

A AI Accountability Network do Pulitzer Center visa apoiar investigações jornalísticas que abordam o uso de inteligência artificial por governos e corporações. (Foto: Centro Pulitzer)

“Vimos que havia muito poucos jornalistas que estavam de olho na questão dos algoritmos que tomam decisões que impactam a vida das pessoas”, disse Boyoung Lim, gerente da rede de inteligência artificial do Pulitzer Center , à LatAm Journalism Review (LJR). “Pensamos que isso era algo em que poderíamos intervir e construir comunidade, capacidade e também, esperamos, colaboração entre jornalistas para relatar os impactos de tecnologias como inteligência artificial e algoritmos na vida das pessoas e das comunidades."

Naundorf é correspondente na América do Sul da rede suíça SRF e seu trabalho já foi publicado em veículos como Revista Anfibia, The Washington Post e Der Spiegel. Por sua vez, Pabst pertence ao Ayün Fotógrafas, um coletivo de oito fotógrafas que aborda temas como identidade, direitos humanos, mulheres e meio ambiente na América Latina. Ambas publicaram no ano passado o especial "Femicidas de uniforme: os erros do sistema", uma reportagem investigativa sobre vítimas de feminicídio nas mãos da polícia na Argentina, também com o apoio do Pulitzer Center.

Naundorf e Pabst trabalharão juntos na AI Accountability Network com uma proposta de projeto jornalístico escrito e visual sobre o uso de tecnologias de automação na Argentina e no Brasil.

“Elas combinarão suas especialidades para atingir um público mais amplo, visualizando algumas das histórias que produzirão através da fotografia de Sarah e outros efeitos visuais inovadores”, disse Lim. “Estou muito empolgada com este projeto por causa do visual, sobre como os fotojornalistas podem cobrir esses tipos de histórias de IA que parecem ser muito técnicas e abstratas”.

Em sua proposta de projeto para a AI Accountability Fellowship, Naundorf e Pabst levantaram questões críticas sobre como os jornalistas devem cobrir as ferramentas de IA que afetam a vida das comunidades ao redor do mundo e, em particular, na América Latina.

“Vivemos em um continente desigual e sabemos que existe o risco de que os sistemas de inteligência artificial reproduzam preconceitos humanos, o que poderia reforçar a desigualdade social”, disse Naundorf à LJR . “A inteligência artificial parece ser um tema com o qual o público não se importa ou sobre o qual não tem influência. [...] Embora existam iniciativas cidadãs, universitárias e de ONGs que questionam o uso da inteligência artificial, e que também buscam reparação judicial, elas recebem relativamente pouca cobertura da mídia. Por isso, acreditamos que é um momento importante para olhar para o continente, sublinhando a necessidade de regulamentação e debate público”.

Os bolsistas receberão até US$ 20 mil para realizar seus projetos durante o restante de 2022. Além disso, terão mentorias e sessões de treinamento para fortalecer suas reportagens.

A previsão é de que as reportagens sejam publicadas entre novembro deste ano e janeiro de 2023. Mas, sobretudo, o Pulitzer Center busca que surjam projetos colaborativos entre os integrantes da primeira geração do programa que continuem explorando a cobertura de inteligência artificial, mesmo após o término da iniciativa.

“Já estamos analisando algumas possíveis colaborações entre os bolsistas, é muito empolgante. Não posso falar muito sobre os detalhes, mas já existem algumas sobreposições que vemos entre seus projetos e eles já estão falando sobre colaborações, então será muito interessante ver em alguns meses”, disse Lim.

Mas por que é importante que os jornalistas monitorem o uso da inteligência artificial? O Pulitzer Center considera que a aplicação dessas tecnologias em áreas como segurança pública, programas sociais, controle de fronteiras e recursos humanos, entre muitas outras, pode alterar a dinâmica do poder, pois são tecnologias capazes de tomar decisões que às vezes são vantajosas para os setores mais privilegiados. Daí a necessidade de exercer a responsabilidade.

Não se trata, disse Lim, de perseguir ninguém ou exigir explicações, mas de jornalistas e, eventualmente, o público em geral poderem entender melhor essas tecnologias para ter as ferramentas para questionar seu uso em áreas cruciais para a sociedade.

"Trata-se de olhar para as tecnologias que estão presentes em nossas vidas diárias com uma lente de justiça e responsabilidade", disse. “Esperamos que esta primeira geração seja o começo de uma comunidade crescente de jornalistas ao redor do mundo que concordam conosco que todos devemos reportar sobre inteligência artificial e que precisamos estar mais conscientes de como essas tecnologias estão transformando e influenciando nossas vidas e, às vezes, afetando desproporcionalmente minorias e grupos marginalizados."

Depois de dois anos realizando a iniciativa Collab Challenge, um experimento que reuniu jornalistas de diferentes partes do mundo para explorar soluções inovadoras que melhoram o jornalismo por meio da inteligência artificial, a organização JournalismAI apresentou em junho de 2022 a primeira geração de sua JournalismAI Fellowship.

Esta é uma versão renovada do Collab Challenges em que 46 jornalistas e técnicos de meios de comunicação de 16 países trabalharão em dez equipes durante seis meses desenvolvendo projetos que exploram como o uso responsável da inteligência artificial pode contribuir para a construção de um jornalismo mais sustentável, inclusivo e independente em todo o mundo.

Um total de 46 jornalistas e técnicos de mídia de 16 países trabalharão em dez equipes por seis meses como parte da primeira Bolsa de Jornalismo AI. (Foto: JornalismoAI)

Ao contrário dos desafios anteriores, o JournalismAI Fellowship tem a particularidade de convocar não só jornalistas, mas também profissionais técnicos dos meios de comunicação, que se juntarão a parceiros de outros meios de comunicação para trabalhar no mesmo projeto.

Entre os 46 participantes selecionados estão representantes de cinco organizações jornalísticas da América Latina. Schirlei Alves e Reinaldo Chaves, da Abraji (Brasil), farão parceria com Fernanda Aguirre e Gibrán Mena, do Data Crítica (México); Lucila Pinto e Nicolás Russo, do Grupo Octubre (Argentina), trabalharão na mesma equipe de Sara Campos e Eduardo Ayala, do El Surti (Paraguai); e Juliana Fregoso e Matías Contreras, do Infobae (Argentina), farão parceria em outra equipe.

“As dez equipes de bolsistas continuam a tradição do JournalismAI de promover a colaboração transfronteiriça e interdisciplinar, com cientistas de dados, repórteres, gerentes de produto, pesquisadores e engenheiros de software trabalhando em conjunto com colegas de organizações de notícias em diferentes continentes, incluindo colaborações entre mídia tradicional e mídia digital”, disse em comunicado a organização baseada na London School of Economics and Political Science.

Os projetos das equipes propõem a aplicação da inteligência artificial em funções como monitoramento de discursos de ódio, detecção de conteúdo enganoso, análise automática de imagens, manipulação de grandes quantidades de dados, entre outras. Por meio de seus projetos, os participantes latino-americanos buscarão promover o uso dessas tecnologias na mídia do Sul Global.

A equipe de El Surti e o Grupo Octubre concordaram em desenvolver uma ferramenta que identifica, classifica e descreve imagens usando visão computacional. A intenção é que a ferramenta, que atende pelo nome inicial de Image2Text, reconheça objetos e pessoas em vídeo, imagens estáticas e infográficos e os descreva em inglês e espanhol.

Dada a natureza gráfica do El Surti, a ferramenta ajudaria seu conteúdo a ser consumido por um público mais amplo, incluindo deficientes visuais, e ter melhor desempenho nos buscadores.

“O principal que faz com que nosso conteúdo não consiga ranquear bem nas buscas [do Google] é porque são imagens e ilustrações, e acima de tudo são ilustrações que às vezes são super editoriais, então são difíceis para os robôs lerem”, disse à LJR Sara Campos, integrante da equipe e editora de produto do canal paraguaio. “Começamos a ver que havia também uma necessidade por parte dos nossos colegas de melhorar sobretudo um trabalho de SEO [otimização de mecanismos de busca, na sigla em inglês], de uma distribuição orgânica e natural [dos seus conteúdos]”.

A equipa da Image2Text está ciente de que seis meses não são tempo suficiente para desenvolver a sua ferramenta a 100%, mas impôs o desafio de entregar pelo menos um protótipo, no final do programa, que tenha sido comprovadamente eficaz em pelo menos um caso de investigação.

"Nós estávamos conversando recentemente e dissemos 'não vamos nos concentrar na interface, vamos nos concentrar em fazê-la funcionar por enquanto para um caso específico'", disse Campos. “Talvez não haja uma interface, mas haverá um repositório de código, uma biblioteca em um GitHub aberto [arquivo do portal de armazenamento de código do aplicativo]. [...] O que estamos fazendo agora é decidir exatamente em que caso vai funcionar”.

O Grupo Octubre e o GMA News Online, o veículo filipino que completa a equipe Image2Text, tiveram propostas semelhantes para ferramentas de reconhecimento de imagem. Todos os três meios de comunicação concordaram que encontraram viés ao experimentar essas ferramentas de inteligência artificial.

No caso do veículo argentino, uma ferramenta de reconhecimento de imagem que eles desenvolveram anteriormente (como parte do Innovation Challenge 2021 da Google News Initiative), chamada Visión Latina, buscou identificar personagens relevantes do mundo latino de língua espanhola em imagens e vídeos.

No entanto, eles descobriram que a visão computacional não é muito eficiente na tentativa de identificar personagens do Sul Global, ao contrário de personagens do Hemisfério Norte.

"É um viés gigantesco", disse Campos. “Então nossa proposta de trabalhar uma biblioteca de linguagens [visuais] do sul para o sul também é como uma postura política contra esses modelos. Vamos ver se conseguimos, porque é um desafio."

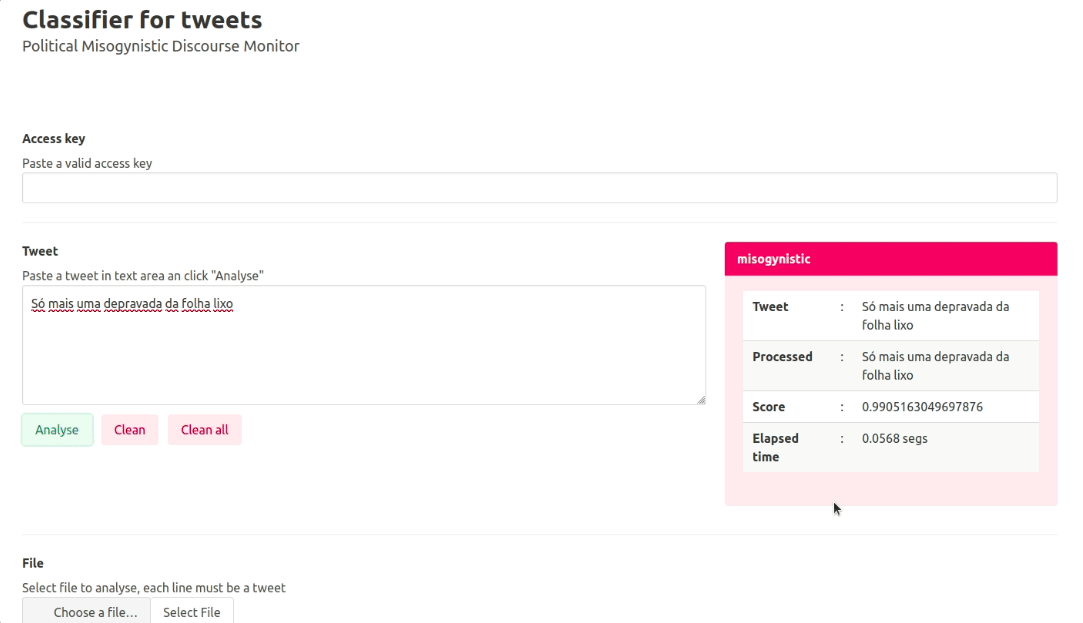

O Monitor do Discurso Político Misógino foi uma ferramenta desenvolvida por jornalistas de redações da América Latina na iniciativa predecessora do JournalismAI Fellowship. (Foto de cortesia)

Os representantes do Infobae encontraram um viés semelhante, neste caso relacionado ao fato de o inglês ainda ser o idioma com o qual a inteligência artificial funciona melhor. A equipe da qual participa o veículo com sede na Argentina, que também inclui SkyNews (Reino Unido) e Il Sole 24 Ore (Itália), planeja desenvolver uma ferramenta que funcione em inglês, espanhol e italiano, cujo objetivo será rastrear os tópicos, marcas e produtos que os influenciadores compartilham nas redes sociais, além de detectar conteúdo potencialmente nocivo ou enganoso.

“De fato, ainda temos um longo caminho a percorrer para chegar a esse ponto em que a inteligência artificial possa falar outras línguas perfeitamente”, disse Juliana Fregoso, gerente de projetos de inteligência artificial do Infobae, à LJR. “Acho que a língua também é uma barreira. Nós na América Latina falamos espanhol ou português e há pouquíssimos jornalistas que realmente falam inglês, então isso é um impedimento [para o uso de inteligência artificial no jornalismo].”

Graças aos perfis dos seus membros, esta equipe pretende complementar o seu projeto com metodologias de jornalismo financeiro e jornalismo de dados. Quanto ao tipo de tecnologia, eles pretendem usar processamento de linguagem natural (NLP, na sigla em inglês) e ferramentas de construção de bancos de dados massivos, como Python, uma linguagem de programação de uso recorrente por jornalistas de dados.

Sua ideia é alimentar enormes bancos de dados sobre as contas das redes sociais para analisar para que sua ferramenta extraia o que é publicado nessas contas, processe e dê uma pontuação de acordo com o quão enganoso ou prejudicial é. Essa ferramenta poderá ajudar jornalistas a investigar histórias sobre publicidade enganosa em plataformas digitais.

“Teremos que nos alimentar por arquivos, que provavelmente montaremos em Python, o que queremos extrair dessas contas e como elas vão nos dar alertas para saber quando os produtos estão sendo anunciados ou se a linguagem que está sendo usada pode ser potencialmente enganosa”, explicou Fregoso.

Por sua vez, a equipe formada por Abraji e Data Crítica tem como projeto o desenvolvimento do Attack Detector, um modelo linguístico para detectar discursos de ódio nas redes sociais em espanhol e português, voltado principalmente para jornalistas e ativistas ambientais.

O Data Crítica participou anteriormente do Collab Challenge 2021 do JournalismAI com o desenvolvimento do Monitor do Discurso Político Misógino, uma ferramenta que, por meio de um modelo treinado de processamento de linguagem natural, detecta discursos de ódio contra mulheres na internet em espanhol e português.

A JournalismAI Fellowship, que conta com o apoio financeiro da Google News Initiative e a assessoria das equipes do Knight Lab da Northwestern University, busca que essas iniciativas, longe de substituir o trabalho dos jornalistas, agreguem valor e capacitem ao automatizar tarefas repetitivas que normalmente levariam muito tempo e esforço para os humanos.

“Acho que podemos começar a trabalhar com uma inteligência artificial híbrida, em que uma parte é efetivamente feita pela parte tecnológica e o resto é feito pelos jornalistas”, disse Fregoso. “Não vejo o uso de inteligência artificial dentro do jornalismo como uma ameaça de tirar nossos empregos. Vejo isso como uma oportunidade de reinventar o jornalismo.”