Um vídeo em que se ouve a voz do jornalista mexicano Carlos Loret de Mola questionando um projeto de parque interurbano no estado de Querétaro circulou nas redes sociais no final de 2023. O vídeo dá a impressão de ser parte de uma reportagem como aquelas que o jornalista apresenta em seu programa “Loret”, do canal digital Latinus.

No entanto, poucos dias depois, o próprio Loret de Mola desmentiu em suas redes sociais a autenticidade do vídeo e negou que se tratava de sua voz. Meios de comunicação relataram que se tratava de um vídeo gerado com inteligência artificial (IA) e observaram que ele poderia ser parte de uma estratégia de difamação contra o prefeito da cidade de Querétaro, que apresentou o projeto do parque mencionado no vídeo.

Semelhante ao caso de Loret de Mola, no México, circulam há meses vídeos que usam a voz de personalidades como a presidente eleita do México, Claudia Sheinbaum, o magnata das telecomunicações Carlos Slim ou o jogador de futebol argentino Lionel Messi para promover produtos ou aplicativos que prometem gerar renda facilmente.

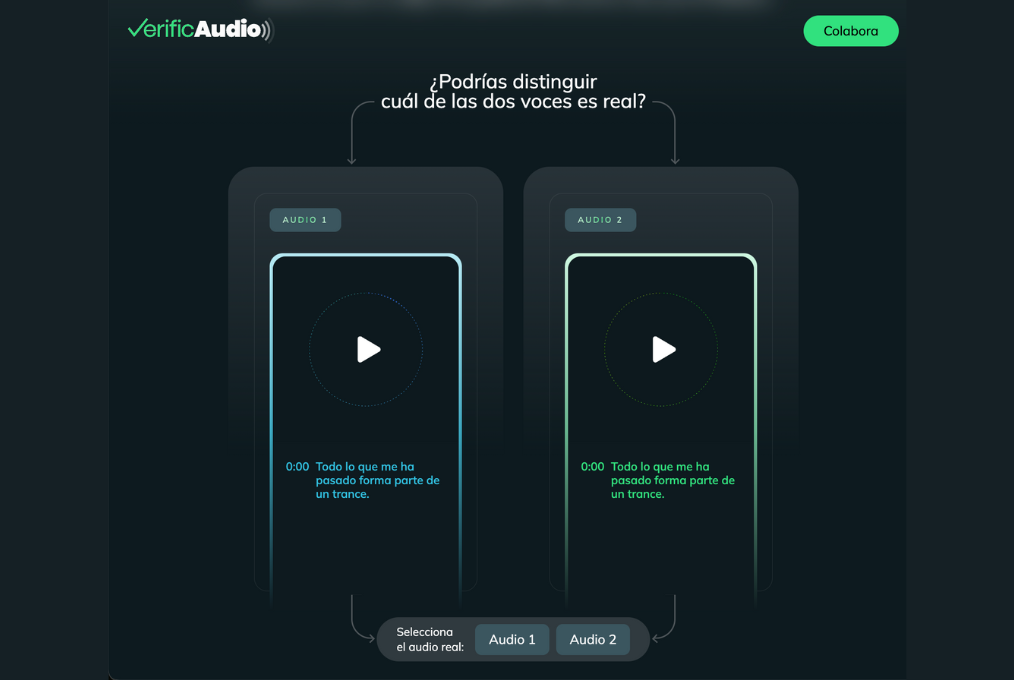

Dois modelos de Processamento de Linguagem Natural (PLN) compõem o VerificAudio, um identificador e outro comparativo. (Foto: Captura de tela do site do VerificAudio)

Carlos Urdiales, diretor da estação W Radio no México, onde Loret de Mola apresenta um programa de notícias ao meio-dia, considera que a tecnologia que possibilitou o vídeo com a voz clonada do jornalista pode ser extremamente perigosa este ano no México, considerando que o país acabou de realizar a maior eleição de sua história.

Por isso, disse, sua estação abraçou desde o início o projeto VerificAudio, uma ferramenta de IA que busca combater a desinformação em conteúdos sonoros. A ferramenta foi desenvolvida por iniciativa do grupo espanhol de mídia Prisa, do qual fazem parte a W Radio e outras quase 30 marcas de radiodifusão na Espanha e na América Latina.

“Sabemos que a inteligência artificial é uma ferramenta que nos apresenta desafios como jornalistas, pelos deepfakes, neste ano mega eleitoral a nível global”, disse Urdiales à LatAm Journalism Review (LJR). “Ter à disposição o uso correto da inteligência artificial [...] adquire um valor enorme, sobretudo em termos de nossa responsabilidade perante nossos ouvintes”.

O VerificAudio foi apresentado em março de 2024, após passar por um período de teste de quase três meses, durante os quais os modelos de IA que a compõem continuaram sendo treinados e as equipes das estações Cadena SER (Espanha), ADN (Chile), Caracol (Colômbia) e W Radio (México), todas da Prisa, foram capacitadas com vistas a integrar a ferramenta em seus protocolos de verificação de fatos. Embora até o momento VerificAudio tenha estado disponível apenas para as estações da Prisa, Ana Ormaechea, diretora de produto digital da PRISA Radio, afirmou que a empresa consoidera disponibilizá-la a outros jornalistas.

“A ferramenta já está em um nível de maturidade alto e estamos dispostos a abrir um cenário de colaboração com outros meios que estejam interessados”, disse Ormaechea à LJR.

O rápido aperfeiçoamento das técnicas de clonagem de voz com o uso de IA e o mau uso dessas técnicas são duas das mudanças mais preocupantes que o ecossistema de mídia nos países de língua espanhola enfrenta atualmente, disse Ormaechea.

Por isso, para a Prisa Radio, o VerificAudio é uma ferramenta para combater os cada vez mais sofisticados deepfakes em áudio e, com isso, proteger a confiança que suas estações consolidaram entre seus ouvintes ao longo de várias décadas.

“Este ano vimos que mais da metade da população [global] votaria. Temos eleições importantes no México, nos Estados Unidos, além de aqui [na Espanha] termos as europeias. Sabemos que sempre que há um período eleitoral importante, infelizmente, surgem situações de desinformação”, disse Ormaechea. “Tínhamos muito medo de que, com esse avanço da tecnologia e a aplicação da IA à clonagem de vozes, em meio a essa situação eleitoral, houvesse um grande aumento de desinformação por meio do áudio durante 2024”.

A Prisa encarregou o desenvolvimento do VerificAudio à empresa espanhola de tecnologia Minsait, que trabalhou nele por cerca de um ano. O projeto contou com o apoio da Google News Initiative, tanto no desenvolvimento da ideia quanto no financiamento para sua execução.

A Google News Initiative decidiu apoiar o projeto porque ele se alinha com dois dos pilares que a empresa de tecnologia busca atualmente: o desenvolvimento de IA e o combate à desinformação.

“O VerificAudio se junta a um grupo de ferramentas-chave que os jornalistas podem usar na hora de verificar informações. Este é um claro exemplo de como a inteligência artificial pode ajudar o jornalismo e a informação de maneira correta”, disse à LJR Haydée Bagú, gerente de novas parcerias da Google América Latina.

Dois modelos de Processamento de Linguagem Natural (PLN), um identificador e outro comparativo, compõem o VerificAudio. O identificador é um modelo de machine learning que compara o material suspeito com áudios que constam em arquivos das estações da Prisa. Ao cotejar o áudio suspeito por meio de um conjunto de indicadores predeterminados, ele fornece um percentual de autenticidade, explicou Ormaechea.

A voz da presidente eleita do México, Claudia Sheinbaum, foi manipulada em vídeos durante sua campanha eleitoral. (Foto: Captura de tela do Facebook do partido Morena)

O modelo comparativo é um modelo de código aberto conhecido como “transformer” de redes neurais, que foi submetido a um processo de fine-tuning para adaptá-lo ao espanhol. De acordo com a Google, um "transformer" é um modelo de PLN que transforma uma sequência de entrada em uma sequência de saída, para o qual "aprende" elementos de contexto e as relações entre os componentes dessas sequências.

O modelo "transformer" do VerificAudio converte cada peça de áudio em uma série de vetores que representam as particularidades da voz, como timbre, entonação e padrões de fala, e depois os compara com os dos áudios preexistentes para detectar indícios de clonagem.

Esse protocolo de dupla verificação busca aumentar a precisão da ferramenta e minimizar o número de resultados falsos. Ambos os componentes foram treinados pela Prisa com áudios de vozes reais e vozes clonadas, disse Ormaechea, que acrescentou que a prioridade da empresa é continuar treinando o VerificAudio com o apoio das estações filiadas na Espanha e na América Latina, para que a ferramenta seja capaz de reconhecer e analisar vozes com diferentes sotaques do espanhol.

"Os maus elementos avançam muito rápido. Todos os dias acordamos com um novo avanço. Precisamos que, no dia a dia, continuemos treinando os modelos para que possam estar no nível de eficácia que essa desinformação tem. Esses deepfakes estão cada vez melhores e sendo distribuídos muito bem", disse Ormaechea.

Após seu lançamento em março, a Prisa lançou um site com uma interface aberta do VerificAudio para apresentar a ferramenta ao público em geral e permitir que os usuários enviassem áudios suspeitos para serem analisados. Enquanto isso, a ferramenta foi submetida a um processo de treinamento de seus modelos para afinar seus resultados e "acostumá-la" aos sotaques de cada país onde a Prisa está presente, antes de colocá-la em uso em suas redações.

Ormaechea disse que a empresa criou um comitê verificador transversal, composto por membros da equipe de notícias de cada uma das estações da Prisa. Esse comitê é responsável por analisar os áudios enviados pelo público através do site do VerificAudio e também utiliza esses áudios para continuar o treinamento dos modelos.

Esses membros da equipe são os que eventualmente estarão encarregados da ferramenta em cada estação. Na W Radio, foram designados dois membros da redação, um da equipe digital e outro da produção de notícias, disse à LJR Emmanuel Manzano, diretor de mídia digital da W Radio.

"Depois dessa capacitação ou curva de aprendizado por parte da redação, já nas próximas semanas começarão a usá-la de maneira prática", disse Manzano, que disse esperar o início do uso da ferramenta na estação mexicana nos primeiros dias de junho.

O objetivo do VerificAudio não é substituir os protocolos de verificação das redações, nem validar ou desmentir conteúdo de áudio. A intenção da Prisa com a ferramenta é que esta forneça uma avaliação das características do áudio e um percentual de confiabilidade para que os jornalistas tomem uma decisão final sob os padrões de fact-checking de seus meios.

"Por isso existe esse comitê [em cada estação], porque não se trata apenas de colocar [o áudio suspeito] na ferramenta e que ela faça uma validação", disse Manzano. "Também é preciso dar contexto ao próprio áudio, de onde ele veio, o que o gerou, a validade da informação que está sendo ouvida no áudio... Há muito mais do que apenas colocá-lo na ferramenta, há todo um processo".

Urdiales acrescentou que, na W Radio, não se espera que o VerificAudio substitua os jornalistas nas tarefas de verificação de conteúdo, e disse que a análise de contexto feita pelos jornalistas é fundamental para desmentir os deepfakes.

O jornalista Carlos Loret de Mola é outra vítima da clonagem de voz. A estação em que seu noticiário é transmitido, W Radio, é uma das que participam do projeto VerificAudio. (Foto: Captura de tela do Facebook da W Radio)

"O VerificAudio dá a possibilidade de processar e obter dados mais firmes e maior certeza sobre a autenticidade de um conteúdo, e tomar decisões a partir disso", disse Urdiales. "Mas ao final desse processo de construção de conteúdo jornalístico informativo, as instituições e as estruturas dos profissionais de uma redação continuam tendo um grande peso".

Para o jornalista, a ferramenta chegou em um momento muito oportuno à sua redação, alguns meses antes das eleições presidenciais que ocorreram em 2 de junho no México. No entanto, ele disse que, embora durante o período de campanhas eleitorais naquele país houvesse alguns casos de áudios com vozes supostamente clonadas de membros da política, estes foram relativamente simples de desacreditar e não causaram um grande impacto no processo eleitoral.

Ormaechea disse que até o início de junho, a interface pública do VerificAudio havia recebido deepfakes procedentes principalmente da Venezuela e do México, mas também de outros países como Estados Unidos ou Cuba.

"Nossa meta foi fazer o VerificAudio muito rapidamente para colocá-lo em uso internamente e continuar realizando testes e aprimorando-o antes das eleições no México", disse Ormaechea. "Para nós, as eleições no México, e acredito que também as dos Estados Unidos – porque também haverá deepfakes em espanhol nas dos Estados Unidos – seriam o foco principal".

No entanto, para Urdiales, o que vem no futuro próximo é mais preocupante quanto ao nível de sofisticação dos deepfakes e o impacto que eles podem ter na credibilidade dos meios de comunicação.

"Cada vez mais nos deparamos com áudios que nos fazem pensar 'meu Deus, se eu já estou duvidando, isso significa que o público em geral pode acreditar muito facilmente'", disse. "Preocupa-me mais o que está por vir, e ter essa ferramenta nos prepara melhor para uma demanda maior de capacidade".

Manzano acrescentou que o VerificAudio contribuiu para sensibilizar os jornalistas da W Radio sobre os níveis de alcance que a IA pode ter no jornalismo, tanto para o bem quanto para o mal.

"Esse é um grande objetivo dessa ferramenta, não apenas identificar [conteúdo manipulado], mas também conscientizar nossa redação e ajudá-los a aprender mais sobre isso", disse Manzano.