Medios y creadores de contenido recurren al “algospeak”, la alteración de palabras o el uso de eufemismos para mantener visibilidad y evadir restricciones de los algoritmos.

Cuando el portal de noticias En Blanco y Negro, de la ciudad de Chihuahua, al norte de México, se planteó aumentar su audiencia en redes sociales, se topó con el hecho de que las principales plataformas digitales frecuentemente restringían la visibilidad de temas como crimen e inseguridad.

El equipo del medio, liderado por su entonces director de noticias Roberto Álvarez, notó que los posts que incluían palabras como “ejecutado”, “drogas” o “narco” recibían menos tráfico, o incluso eran amonestados por presuntas violaciones a las normas de contenido.

Fue entonces que comenzaron a adoptar una estrategia que influencers y creadores de contenido utilizan para darle la vuelta a los algoritmos de las redes sociales: inventar o alterar palabras.

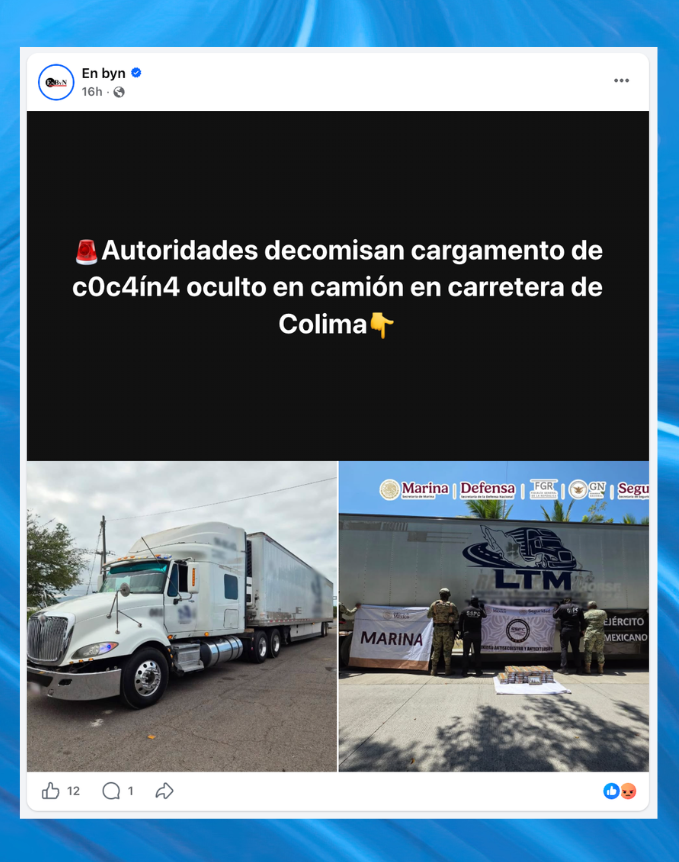

Cuando el medio digital En Blanco y Negro utiliza palabras alteradas en sus titulares, el tráfico aumenta. (Foto: En Blanco y Negro en Facebook)

“‘Ejecutar’ es la palabra que más usamos en México para decir que alguien fue asesinado a balazos”, dijo Álvarez a LatAm Journalism Review (LJR). “¿Qué podíamos hacer para no arriesgarnos? Empezamos a usar la palabra ‘desvivir’, que no existe, no está en el diccionario”.

El equipo comenzó también a cambiar la ortografía de las palabras por un equivalente formado por letras, números y símbolos. Así, “ejecutar” se convirtió en “3jecut4r”, “drogas” en “dr0g4s”, y “narco” en “n@rcø”.

“Cuando empezamos a ver el tráfico en tiempo real y vemos que está muy bajo, cambiamos inmediatamente las palabras o las inventamos conforme a un ‘slang’ más de aquí de Chihuahua y rápido empieza la misma publicación a subir su tráfico”, dijo Álvarez.

El caso de En Blanco y Negro ilustra una práctica en redes sociales cada vez más extendida entre los medios: alterar el lenguaje para evadir la moderación algorítmica. Conocida como “algospeak”, esta estrategia busca mantener la visibilidad de los contenidos y evitar sanciones, aunque también puede generar rechazo de los lectores y afectar la claridad de los mensajes.

El “algospeak”, de los términos “algoritmo” y “speak” (hablar en inglés), consiste en modificar, sustituir o disfrazar palabras consideradas sensibles mediante eufemismos, alteraciones ortográficas o símbolos.

Su uso en las noticias no es aislado. Una investigación de la Universidad Autónoma de Chihuahua (UACH), publicada en septiembre de 2025 en la revista académica Doxa, documentó cómo al menos tres medios digitales de esa ciudad están adaptando su lenguaje en Facebook para evitar la moderación algorítmica.

A partir del estudio de 312 titulares, la investigación, titulada “Cuando el muerto es ‘desvivido’: el ‘algospeak’ periodístico como respuesta a la censura digital”, encontró que periodistas recurren de forma sistemática a la alteración ortográfica, los eufemismos y, en menor medida a símbolos o metáforas, para publicar contenidos informativos principalmente sobre violencia, muertes y seguridad, sin ser penalizados por las plataformas.

“Esta es una presentación novedosa de una problemática que el periodista ha tenido siempre, que es evadir la censura”, dijo a LJR Mario Alberto Valdez, periodista, profesor de la UACH y uno de los autores de la investigación. “Ahora lo vemos desde un tema tecnológico”.

La investigación encontró que más del 90 por ciento de las publicaciones recurrieron a la alteración ortográfica de palabras sensibles, seguida por el uso de eufemismos léxicos, es decir, palabras o expresiones para sustituir otras consideradas ofensivas. La mayoría de los titulares con palabras alteradas se concentró en publicaciones sobre fallecimientos, seguridad y narcotráfico, y con menor presencia en contenidos sobre drogas, sexualidad y maltrato humano.

Que los temas de nota roja sean los mayormente castigados por las redes sociales representa un reto para los medios de estados como Chihuahua, donde este tipo de noticias están entre las más consumidas por la audiencia, dijo Valdez.

Pero los temas de violencia no son los únicos restringidos por los algoritmos. Perfiles que abordan temas de género también tienen que recurrir al “algospeak” para lograr que su contenido llegue a su audiencia, de acuerdo con otra investigación, publicada en marzo de 2026 del medio mexicano La Cadera de Eva y la organización Artículo 19.

Sofía Márquez, creadora de contenido y fundadora de la plataforma sobre feminismo y violencia de género We R Women On Fire, con sede en Tijuana, dijo que en muchas de sus publicaciones en Instagram tiene que alterar términos.

“Hay penalizaciones desde eliminar por completo el contenido, quitar el uso de ciertas herramientas –en una ocasión me bloquearon la opción de hacer en vivos por seis meses–, y hasta el riesgo de que eliminen tu cuenta por completo”, dijo Márquez a LJR.

En sus publicaciones, que siguen casos de violencia contra mujeres y movimientos feministas, se pueden ver términos como “v1olador”, “s3xual” y “f3minicid4”, tanto en texto como en imágenes.

“Es impresionante como el contenido informativo, reflexivo y consciente siempre es censurado, mientras que otros contenidos que replican violencias son difundidos con mayor fuerza dentro del algoritmo patriarcal que vemos en redes sociales”, dijo Márquez.

Entre 2023 y 2025, cuando la crisis migratoria en México tuvo varios picos, las plataformas de Meta solían castigar el contenido de En Blanco y Negro relacionado con migración, dijo Álvarez.

La plataforma sobre temas feministas y de género We R Women On Fire altera ciertos términos en su contenido para evitar penalizaciones en redes sociales. (Foto: We R Women On Fire en Instagram y Canva)

“Si ponías la palabra ‘inmigrante’ o ‘indocumentados’ en Facebook, te podían incluso poner un ‘baneo’ de un día en la cuenta”, dijo Álvarez. “La notificación te decía ‘posiblemente esté incurriendo en una violación de nuestras políticas de violencia o discriminación’. Y nosotros pensábamos ‘claro que no, ¡estoy informando!’ ”

Fue entonces que su redacción encontró una alternativa en los eufemismos. Para evitar decir “inmigrantes”, optaron por usar “personas en situación de movilidad”.

A veces los eufemismos que elegían rayaban en el amarillismo, reconoció Álvarez. En una ocasión, el medio reportó sobre abusos sexuales a menores en una región marginada de Chihuahua.

Fue entonces que decidieron usar el eufemismo: “Depredador ‘se llevó al plato’ a 500 niños en Punta Oriente”. Aunque algunos lectores expresaron molestia, dijo Álvarez, el medio optó por hacerlo con tal de que la noticia no fuera invisibilizada.

“Curiosamente, siendo más amarillistas Facebook sí nos llevó tráfico”, dijo Álvarez. “Tiene que ser así porque no le vamos a hacer el favor a ninguna autoridad de no informar”.

Meta indica en su sitio web que sus sistemas reducen la exposición de contenidos que infringen sus normas comunitarias, “a fin de minimizar daños potenciales”. Esto incluye contenido relacionado con violencia gráfica, lenguaje que incita al odio, suicidio, autolesión y fraudes.

La empresa indica que permite este contenido sensible si es “de interés periodístico”, pero antes lo somete a un análisis de derechos humanos.

No obstante, si un medio o periodista está en desacuerdo con una decisión de la plataforma, no hay mucho que se pueda hacer, dijo Álvarez.

“Para que te resuelvan un problema, puedes mandar una apelación, pero todo está muy automatizado”, dijo. “Es casi imposible ponerte en contacto con alguien”.

Si bien el “algospeak” ayuda difundir información de interés público, también es cierto que la claridad periodística puede verse comprometida, de acuerdo con la investigación de la UACH.

“Los chavos inmediatamente entienden el porqué de estas estrategias porque ellos lo viven día a día”, dijo Valdez. “Pero nos topamos con perfiles de personas mayores que no entendían esta forma de manejar la información”.

Márquez dijo que en ocasiones los seguidores de We R Women On Fire perciben la alteración de palabras como falta de seriedad o como una forma de suavizar el contenido.

“Me gusta siempre compartir los hechos como son, sin ocultar ni maquillar nada, y al censurar palabras o imágenes, hay personas de la audiencia que cuestionan el porqué lo hago”, dijo. “Asumen que es por no querer mostrar toda la realidad”.

Cuando lectores de En Blanco y Negro expresaron su descontento por la alteración de palabras y el uso de eufemismos, el medio explicó la razón en un artículo escrito por Álvarez en agosto de 2025 para aclarar que el “algospeak” era una estrategia necesaria.

La nota incluye un glosario de 30 términos que el medio modifica rutinariamente en áreas incluyendo el crimen organizado, decesos y delitos sexuales.

“En pocas palabras”, concluye, “no es ignorancia, es supervivencia digital”.

En Blanco y Negro compartió una imagen en la que explicaba las razones de utilizar el “algospeak”. (Foto: Captura de pantalla de enblancoynegro.com.mx y Canva)