Uma imagem do Papa Francisco vestindo um casaco branco da Balenciaga e uma série de fotos do ex-presidente dos EUA, Donald Trump sendo rendido por pela polícia causaram polêmica na mídia e nas redes sociais em março deste ano. Não demorou muito até verificadores de fatos esclarecerem que eram imagens criadas pelo aplicativo de inteligência artificial generativa Midjourney, que cria imagens a partir de descrições feitas em textos.

Conteúdos falsos e hiperrealistas, como os dois casos acima, levantaram bandeiras vermelhas devido à alta capacidade de gerar desinformação e manipular a opinião pública. Por vários anos, verificadores de conteúdo e empresas de tecnologia vêm tentando encontrar uma resposta contundente para combater o poder dos deepfakes, como são conhecidas as peças audiovisuais criadas por inteligência artificial que parecem autênticas, mas são falsas.

Um projeto chamado Iniciativa de Autenticidade de Conteúdo (CAI), liderado pela empresa de software Adobe, busca combater a desinformação por meio da implementação generalizada de um padrão de tecnologia que fornece informações sobre a origem e sobre alterações de conteúdo digital na internet.

A iniciativa busca unir diversos setores, incluindo a mídia, empresas de tecnologia e fabricantes de dispositivos, para que promovam um protocolo de código aberto com interoperabilidade entre múltiplas ferramentas.

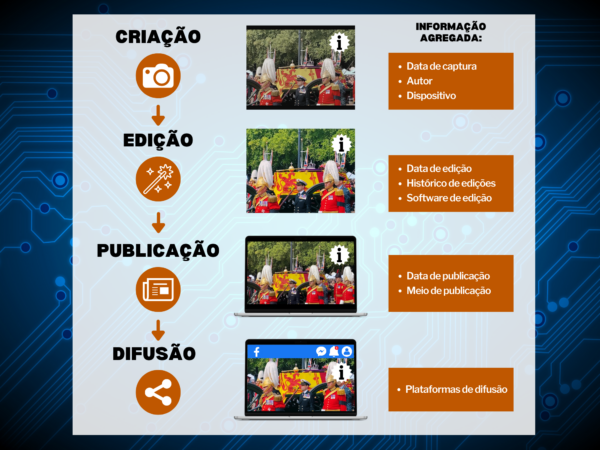

Infográfico descrevendo as informações adicionadas às fotos de acordo com o padrão Content Authenticity Initiative (Foto: Norma Galván via Canva.com)

“Com o advento da inteligência artificial, surgiu a possibilidade de uma grande proliferação de informações falsas e ainda mais difíceis de detectar”, disse à LatAm Journalism Review (LJR) o jornalista John Reichertz, consultor do CAI para a América Latina. “O que a iniciativa busca é tentar dar ao público elementos com a ideia de transparência, que é um valor do jornalismo, para que este possa determinar se uma imagem, uma gravação de vídeo e, eventualmente, um documento, é real ou falso ".

O padrão de tecnologia de código aberto da iniciativa permitirá a integração de “credenciais de conteúdo” em arquivos digitais. Ou seja, os arquivos conterão dados de proveniência que fornecem aos usuários informações contextuais invioláveis sobre as alterações feitas no seu conteúdo ao longo do tempo, desde a sua geração em um dispositivo até a sua publicação em um meio ou plataforma, incluindo dados sobre a sua identidade, os tipos de edição usados e as modificações executadas.

O CAI propõe que, uma vez implementado o padrão, cada imagem e vídeo na Internet inclua um símbolo de informação (i) no canto superior direito, que, ao ser clicado, mostrará os dados de origem e alterações. Em uma versão posterior, a ferramenta permitirá até que você visualize diferentes versões de cada conteúdo, desde o arquivo original até o arquivo publicado, disse Reichertz.

“É muito parecido com quando você vai comprar uma lata de tomate no supermercado e vê uma lata que só diz 'tomate' e não tem nenhuma outra informação, e vê outra lata que inclui um rótulo nutricional com data, prazo de validade, e diz que além do tomate lá há água, sódio, corantes, conservantes”, explicou. “Quase certamente você vai levar a lata que tem informações. É o mesmo conceito que você está consumindo um produto e quer saber mais sobre sua origem e como é o conteúdo”.

As imagens do Papa e de Trump este ano não foram as primeiras deepfakes a viralizar. Em 2017, pesquisadores da Universidade de Washington criaram um vídeo falso de Barack Obama a partir de uma técnica de inteligência artificial que "aprendeu" a reproduzir com precisão os movimentos do ex-presidente ao falar.

A diferença é que, seis anos depois, a geração de imagens falsas hiperrealistas já não requer um grupo de especialistas em inteligência artificial. Quase qualquer pessoa pode criá-las em aplicativos como Midjourney, Dall-E ou Stable Diffusion, o que pode levar a um ponto em que você não pode dizer qual conteúdo na internet é real e qual não é.

"Antes, para falsificar [material] você tinha que entender de Photoshop ou algum outro programa, tinha que ter alguma habilidade e também investir em um programa", disse Reichertz, que foi editor para a América Latina das agências Reuters e EFE. "Hoje qualquer um pode fazer isso, e há várias implicações".

Uma dessas consequências é que a desconfiança das pessoas na mídia pode crescer ainda mais, disse o jornalista. De acordo com a edição mais recente do Digital News Report do Instituto Reuters, mais da metade dos meios consultados em todo o mundo têm dificuldade em distinguir entre notícias verdadeiras e falsas na internet. O ecossistema informacional contaminado por conteúdos alterados acaba impactando a credibilidade do público em todas as fontes de informação, inclusive na mídia jornalística .

“As pessoas têm muita dificuldade em distinguir entre o que é real e o que não é real. Quando você começa a duvidar do que é real e do que não é real, você começa a questionar tudo, e para a indústria da mídia, isso é, na minha opinião, uma crise existencial, porque o maior valor do produto jornalístico é a sua credibilidade”, disse .

Neste momento, o CAI dá grande ênfase à implementação de seu padrão tecnológico com fotografias. No entanto, espera-se que nos próximos anos todos os tipos de conteúdo digital incluam dados sobre sua origem e alterações.

Embora a iniciativa ainda esteja em seus estágios iniciais e ainda não tenha sido adotada por nenhum fabricante de câmeras, duas marcas de câmeras – Nikon e Leica – se comprometeram a implementar o código CAI em seus equipamentos mais usados por profissionais, disse Reichertz. Por sua parte, a Truepic, empresa especializada em autenticidade de conteúdo digital, está desenvolvendo um software para tornar o padrão da tecnologia compatível com smartphones.

Além disso, a Adobe já incluiu o recurso de credenciais de conteúdo em uma versão Beta do Photoshop, um dos programas de edição de imagem mais populares do mundo, bem como no Firefly, seu produto generativo de inteligência artificial.

A Content Authenticity Initiative busca implementar seu padrão tecnológico em todo o processo de conteúdo na Internet. (Arte: César López Linares)

Apesar de todas as principais agências internacionais do Ocidente terem aderido ao CAI, incluindo AFP, AP, EFE e Reuters, Reichertz disse que ainda não está claro quando estas começarão a integrar as credenciais de conteúdo às imagens que disponibilizam aos meios de comunicação que assinam seus serviços.

No entanto, num futuro muito próximo será possível começar a incluir credenciais a partir da fase de edição. A equipe por trás da iniciativa está trabalhando para trazer desenvolvedores de CMS (sistema de gerenciamento de conteúdo) para o projeto com o objetivo de alcançar a interoperabilidade total do padrão tecnológico em todo o processo.

“O que poderia ser feito hoje é da fase de edição em diante, fazer [o arquivo com credenciais] passar pelo CMS e ser divulgado no meio de comunicação, para que, quando as agências começarem a enviar informações com credenciais, elas fluam direto pelo sistema automaticamente”, disse Reichertz. "Ou quando câmeras e smartphones começarem a ter credenciais desde o início, as credenciais fluam por todo o sistema."

As credenciais de conteúdo CAI são baseadas nos metadados de fotografias tiradas com câmeras digitais e smartphones, que comumente incluem dados sobre a imagem, local, dispositivo, medições, entre outros.

A diferença é que, embora os metadados das fotos digitais atuais sejam perdidos quando o material é editado ou exportado, as credenciais do CAI são vinculadas com segurança ao arquivo, e, mesmo que sejam feitas tentativas de alterá-las, essas tentativas também serão refletidas nos metadados dos arquivos.

"Se você tirar uma foto com seu Smartphone, você pode ver onde a registrou e a que horas. Mas essa não é uma informação segura, não está vinculada com segurança ao arquivo da foto e os dados podem ser excluídos ou alterados”, explicou Reichertz. "Neste modelo, tudo é seguro: é criptografado e as informações da foto e sua origem estão intimamente ligadas para que não as informações não possam ser alteradas".

Por serem de código aberto, as ferramentas CAI para a autenticidade e proveniência de conteúdo digital estão disponíveis para que qualquer empresa, meio ou desenvolvedor possa usá-las para criar aplicativos ou integrá-las em seus sistemas. Embora sejam gratuitas, elas requerem um investimento para sua implementação. E, acima de tudo, exigem um esforço colaborativo entre fabricantes de dispositivos, desenvolvedores de software, mídia e plataformas de mídia social, disse Reichertz.

O que os representantes do CAI buscam atualmente é criar um senso de urgência entre os principais atores do mundo digital, apresentar a iniciativa a eles e promover o uso do protocolo tecnológico.

“Deve haver uma pressão esmagadora para que todos os participantes do ecossistema digital concordem em incluir isso como um núcleo de seus serviços ou produtos”, disse Reichertz. “Esse é o objetivo, que essa não seja uma opção boa de ter. A pressão é para que isso faça parte do serviço básico, sem custos adicionais, e com isso todos concordamos”.

O CAI já soma mais de 1.300 adeptos em todo o mundo, incluindo meios de comunicação de renome mundial, como The New York Times, The Washington Post e The Wall Street Journal.

A iniciativa chegou à América Latina em setembro de 2022, quando Reichertz e sua equipe começaram a apresentar o projeto aos principais grupos de notícias e associações de mídia. Em julho de 2023, os meios de comunicação e organizações latino-americanas que apoiaram a iniciativa passaram de 50. Entre eles estão a Associação de Entidades Jornalísticas Argentinas (Adepa), a Associação Nacional de Jornais (ANJ) brasileira, a Associação de Meios de Informação da Colômbia (AMIC) e a Media Alliance do México.

Entre as mídias latino-americanas que aderiram estão organizações de verificação como Ecuador Chequea (Equador), ColombiaCheck (Colômbia), Verificado (México), Chequeado, Proyecto Desconfío (Argentina) e Comprova (Brasil), além de mídias como El Tiempo , El Espectador (Colômbia), Infobae (Argentina), El Mostrador, La Razón (Chile) e Perú21 (Peru), entre outros.

Nesta fase, a missão dos representantes do CAI na América Latina é divulgar a iniciativa e obter o apoio dos meios de comunicação da região. Por enquanto, a iniciativa criou um canal Discord onde os membros podem comentar questões técnicas, e onde decorrem as discussões sobre o projeto.

De acordo com alguns verificadores de fatos latino-americanos que aderiram à iniciativa, embora o CAI não substitua seu trabalho de verificação, o protocolo complementará as suas estratégias tradicionais de combate à informações falsas.

"As soluções para combater a desinformação são múltiplas e colaborativas, e têm surtido pouco efeito quando aplicadas isoladamente. Por isso, buscamos apoiar todas as iniciativas que possam ajudar a melhorar o ambiente informacional", disse. LJR Sérgio Lüdtke, editor-chefe do Projeto Comprova, uma coalizão de 24 veículos de mídia para verificar conteúdo falso no Brasil. “Entendemos que não poderíamos ficar de fora desse esforço conjunto para promover a adoção de um padrão aberto da indústria para a autenticidade e proveniência do conteúdo que circula na Internet e nas redes sociais”.

Ana María Saavedra, diretora da ColombiaCheck, disse que o fato de as organizações líderes em checagem de fatos da América Latina se juntarem ao CAI lhes deu a confiança para também se unirem como membros. Embora até agora a sua equipe não tenha iniciado a implementação do protocolo tecnológico, nos próximos meses ele irão realizar reuniões para delinear os passos a seguir para pôr a iniciativa em prática.

“Consideramos que é um projeto que pode contribuir para o combate à desinformação”, afirmou. “Não é um compromisso muito grande, porque não é que tenhamos assinado um documento em que nos comprometemos a fazer algo que não temos certeza ou que vai contra nossas diretrizes, mas sim que é algo que busca nos apoiar para conseguir identificar a desinformação”.

As organizações de verificação tendem a se concentrar no material mais viral ou de longo alcance, disse Lüdtke. As credenciais de conteúdo podem ajudar a impedir que imagens manipuladas alcancem tal viralidade e desinformem o público. A editora-chefe do Comprova disse esperar que as ferramentas de autenticidade e proveniência de conteúdo digital do CAI ajudem a preparar suas equipes para quando se confrontarem com a missão de verificar deepfakes.

Tanto Lüdtke quanto Saavedra concordam que essas ferramentas funcionarão de forma complementar às técnicas de verificação jornalística já utilizadas por checadores de fatos como pesquisa reversa e análise de detalhes.

“Temos um passo a passo para a verificação de deepfakes, imagens modificadas ou imagens feitas com inteligência artificial”, disse Saavedra. "Fazer verificação do contexto da foto, da veracidade daquela foto, de todos os elementos que é necessário examinar em uma checagem",

Para Adrián Pino, coordenador da organização argentina de fact-checking Proyecto Desconfío, que oferece treinamento em fact-checking para jornalistas da região, o CAI é uma oportunidade para explorar padrões que agilizam o processo de verificação de conteúdos suspeitos.

“Quanto mais sinais pudermos gerar para distinguir o conteúdo autêntico do conteúdo falso, manipulado ou enganoso, mais oportunidades teremos de levar conteúdo confiável aos cidadãos”, disse Pino à LJR. "Quanto mais agências e mídia adotarem esse padrão, mais rápido será o trabalho de verificação".

Reichertz disse que o CAI não se apresenta como solução definitiva para a desinformação em conteúdos digitais, e concordou que o protocolo não substituirá o trabalho dos jornalistas.

“Existem poucas soluções concretas [para a desinformação], e apesar de [o CAI] ser concreto, não é completo. É uma ajuda adicional para combater a desinformação, mas não é a solução", afirmou. "Os verificadores de fatos sabem disso muito bem. Eles sabem muito bem os desafios que vão ter com a inteligência artificial, e sabem muito bem que não vão conseguir dar conta de alcançar tudo”.